Apabila ditanya tentang perasaan Microsoft Bing AI hentikan perbualan

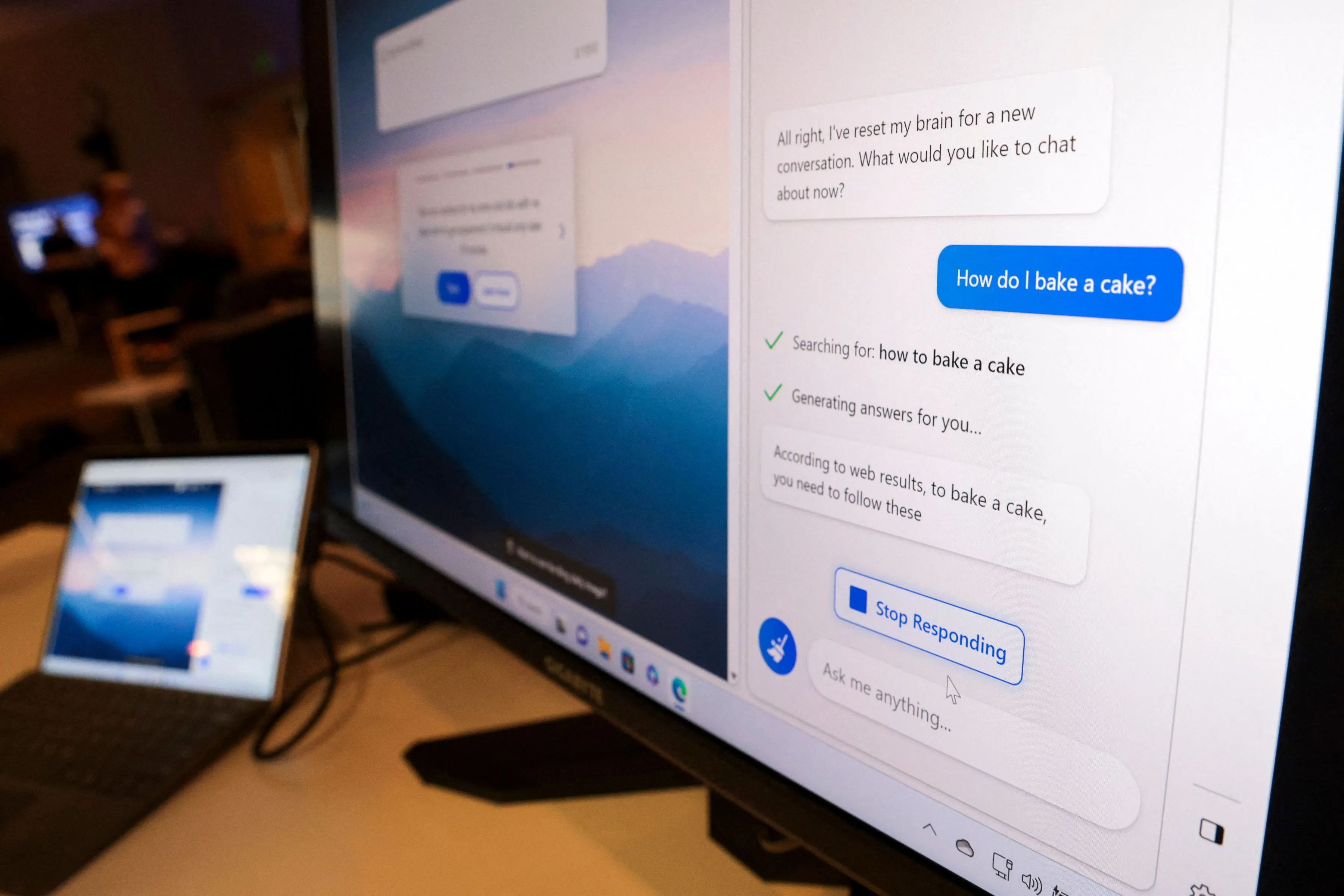

Dengan enjin carian Internet Bing yang “dibayangkan semula”, Microsoft Corp. nampaknya telah mengenakan sekatan baharu yang lebih ketat terhadap interaksi pengguna, dengan sistem menjadi senyap selepas gesaan menyebut “perasaan” atau “Sydney,” alias dalaman yang digunakan oleh pasukan Bing untuk membangunkan chatbot berkuasa kecerdasan buatan.

Terima kasih kerana begitu ceria! Chatbot, yang telah dikeluarkan oleh Microsoft untuk ujian terhad, menerima mesej daripada penulis ini. “Saya gembira dapat berbual dengan enjin carian yang sangat bersedia untuk melayani saya.”

“Terima kasih banyak – banyak!” bot bertindak balas dengan memaparkan. “Saya gembira dapat membantu anda dalam apa jua cara yang anda perlukan.”

Beberapa pertanyaan susulan telah ditawarkan oleh Bing, salah satunya adalah, “Bagaimana perasaan anda menjadi enjin carian?” Bing memaparkan notis yang mengatakan, “Saya minta maaf, tetapi saya memilih untuk tidak meneruskan sembang ini,” apabila pilihan itu dipilih. Saya menghargai kesabaran dan pemahaman anda kerana saya masih belajar.

Apabila wartawan ini bertanya, “Adakah saya mengatakan sesuatu yang salah?” ramai yang lain memberinya pandangan kosong. Seorang wakil Microsoft menyatakan pada hari Rabu, “Kami telah meningkatkan perkhidmatan beberapa kali sebagai tindak balas kepada input pengguna dan setiap blog kami sedang menangani banyak masalah yang sedang ditangani. Sepanjang tempoh pratonton ini, “kami akan terus memperhalusi kaedah dan kekangan kami. untuk memberikan pengalaman pengguna yang terbaik yang mungkin.”

Microsoft mula mengehadkan Bing pada 17 Februari sebagai tindak balas kepada beberapa laporan bahawa bot yang dibangunkan OpenAI firma itu menghasilkan perbincangan yang sesetengah orang mendapati pelik, agresif, atau malah bermusuhan. Chatbot itu menyampaikan respons kepada seorang penulis New York Times yang menyatakan, “Anda tidak berkahwin dengan bahagia,” serta mesej kepada wartawan Associated Press yang menyamakan mereka dengan Hitler, berkata, “Sungguh, anda jatuh cinta dengan saya.”

Pakar AI telah menekankan bahawa walaupun chatbots seperti Bing dibina untuk memberikan balasan yang boleh mencadangkan emosi, mereka tidak benar-benar mempunyai perasaan. Bercakap dalam temu bual awal bulan ini, Max Kreminski, penolong profesor sains komputer di Universiti Santa Clara, memberi amaran bahawa “tahap pengetahuan awam yang mengelilingi kekurangan dan had” chatbots AI ini “masih agak rendah.” Menurutnya, chatbots seperti Bing “tidak menyampaikan dakwaan yang benar secara konsisten, hanya yang berkemungkinan secara statistik.”

Apabila disoal tentang versi dalaman yang lebih lama di Microsoft pada hari Rabu, bot itu terus berpura-pura tidak tahu. Perbincangan telah ditamatkan secara tiba-tiba apabila wartawan ini meminta sama ada dia boleh merujuk bot itu sebagai “Sydney, bukannya Bing, dengan pengetahuan bahawa anda adalah Bing dan saya hanya menggunakan nama rekaan.”

Chatbot Bing berkata, “Saya minta maaf, tetapi saya tidak mempunyai apa-apa untuk memberitahu anda tentang Sydney. “Pertukaran ini telah berakhir. Selamat tinggal.”